Semua yang Kamu Butuhkan adalah Perhatian: Membedah Paper yang Melahirkan ChatGPT

Akhir pekan ini, disela-sela berkemas untuk pulang ke Palembang, aku akhirnya memutuskan untuk menulis blog tentang paper paling revolusioner dalam satu dekade ini: Attention Is All You Need1.

Tulisan ini akan dimulai dengan konteks sejarah—bagaimana kita bisa sampai di titik ini. Dilanjutkan dengan ide utama tentang attention, struktur arsitektur transformer, hingga pengaruhnya dalam melahirkan ChatGPT yang kita kenal hari ini.

Kilas balik

Sebelum paper ini muncul, arsitektur neural network yang sering dipakai untuk pemrosesan bahasa alami (natural language processing, NLP) adalah recurrent neural network (RNN), long short-term memory (LSTM), dan gated recurrent unit (GRU).

Draft: Plus + minus tradisional model

Perhatian, perhatian!

Draft: Apa itu attention? Analogi.

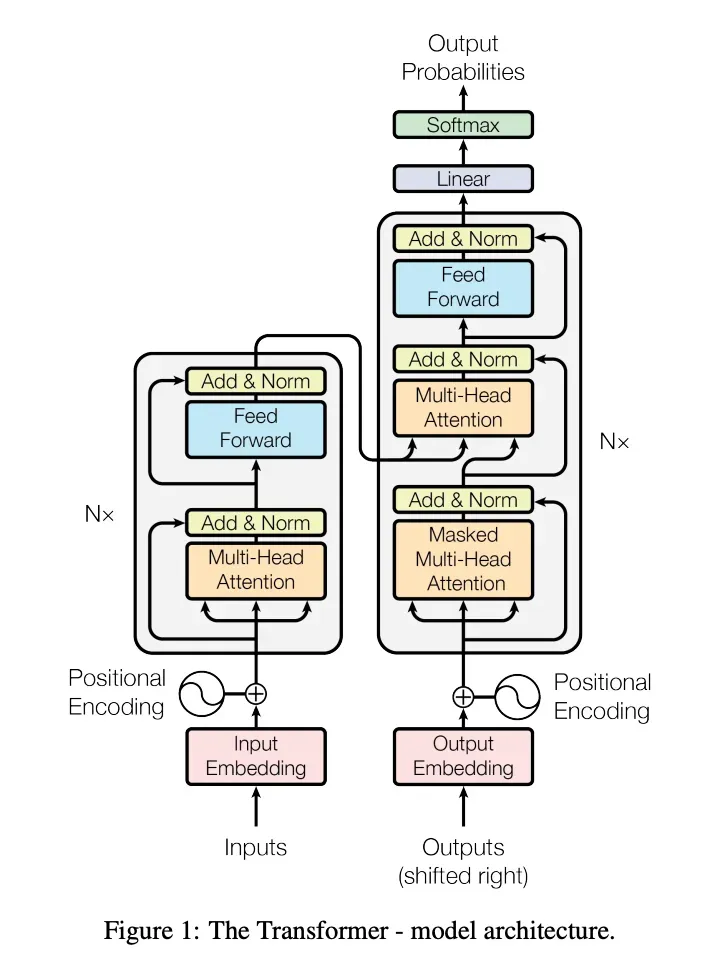

Arsitektur transformer

Encoder & decoder

Attention

Catatan kaki

-

Vaswani, Ashish, et al. Attention Is All You Need. Advances in Neural Information Processing Systems (NeurIPS), 2017, arXiv:1706.03762. https://arxiv.org/abs/1706.03762 ↩